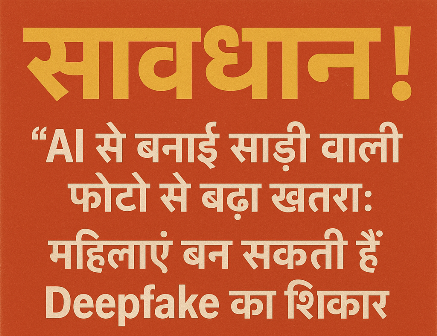

सलोनी तिवारी : नई दिल्ली: पिछले कुछ दिनों में सोशल मीडिया, खासकर Instagram पर, Google Gemini AI Nano Banana Saree ट्रेंड ने धूम मचाई है। लाखों यूज़र्स अपनी साधारण फोटोज़ को इस AI टूल की मदद से बॉलीवुड-स्टाइल साड़ी वाली तस्वीरों में बदल रहे हैं। रिपोर्ट्स के मुताबिक अब तक इस ट्रेंड के जरिए 50 करोड़ से ज्यादा फोटोज एडिट की जा चुकी हैं। लेकिन मज़े के इस खेल के पीछे कई गंभीर खतरे भी छिपे हुए हैं।

क्यों बढ़ रही है चिंता? कई टेक एक्सपर्ट्स का मानना है कि इतनी बड़ी संख्या में लोग अपनी तस्वीरें इस AI टूल के हवाले कर रहे हैं, जिससे डेटा प्राइवेसी का बड़ा खतरा पैदा हो सकता है।

-

ये फोटोज़ भविष्य में Deepfake का शिकार हो सकती हैं।

-

निजी तस्वीरें गलत हाथों में जाने पर ब्लैकमेलिंग, फेक न्यूज़ या ऑनलाइन धोखाधड़ी जैसे अपराध बढ़ सकते हैं।

-

खास तौर पर महिलाएं इस ट्रेंड को ज्यादा फॉलो कर रही हैं, जिससे उनके शोषण का खतरा बढ़ जाता है।

हो सकता है ये साइबर क्राइम का नया रास्ता:

साइबर सिक्योरिटी एक्सपर्ट्स ने चेतावनी दी है कि “Nano Banana” जैसे ट्रेंड लोगों के निजी डेटा को चुराने का जरिया भी बन सकते हैं। कुछ नकली वेबसाइट्स और ऐप्स यूज़र्स को लुभाकर उनका डेटा चुरा लेती हैं। तेलंगाना के पुलिस अधिकारी वी.सी. सज्जनार ने कहा:

“एक बार आपका डेटा नकली वेबसाइट पर पहुंच गया, तो उसे वापस लाना लगभग नामुमकिन हो जाता है। आपका डेटा और पैसा आपकी जिम्मेदारी है।”

लोगों को क्या सावधानियां बरतनी चाहिए?

-

सिर्फ आधिकारिक और भरोसेमंद वेबसाइट/ऐप्स का ही इस्तेमाल करें।

-

अनजान लिंक या पॉप-अप पर क्लिक न करें।

-

अपनी निजी जानकारी (फोटो, बैंक डिटेल्स, आईडी प्रूफ) किसी थर्ड पार्टी साइट पर अपलोड न करें।

-

AI फोटो एडिटिंग का इस्तेमाल सिर्फ मनोरंजन तक ही सीमित रखें।